خیزش هوش مصنوعی از بسیاری جهات از اختراع بمب اتم نیز تهدیدکنندهتر است. این فناوری کشتن در جنگ را سریعتر و ساخت سلاحهای کشتار جمعی را آسانتر میکند. آیا بشریت خواهد توانست آن را بهطور مؤثر مهار کند؟

در نوامبر ۲۰۱۷ یک فیلم کوتاه هشتدقیقهای وحشت در اینترنت بهسرعت فراگیر شد. فیلم Slaughterbots «رباتهای کشتار» یک دیستوپیا را به تصویر میکشد: پهپادهای تهاجمی مجهز به نرمافزار تشخیص چهره وارد کنگره ایلات متحده و دانشگاهها میشوند و سناتورها و دانشجویانی را که علیه فساد مبارزه میکنند، بهطور هدفمند به قتل میرسانند.

در این فیلم روشن نمیشود که چه کسی پشت این حملات قرار دارد: یک دولت، یک گروه تروریستی، یا کارخانهای فوقپیشرفته برای تولید سلاح که سلاحهای مبتنی بر هوش مصنوعی میسازد و رئیس جوان و کاریزماتیک آن، پهپادهای قاتل خودکار را آینده جنگ معرفی میکند.

فیلم «Slaughterbots» بهعنوان هشداری ساخته شد. در پایان فیلم یکی از نویسندگان: Stuart Russell، دانشمند علوم کامپیوتر بریتانیایی آن سخن میگوید. او میگوید این ویدئو نشان میدهد که اگر هوش مصنوعی با سامانههای تسلیحاتی نوین درهم بیامیزد چه خطری به وجود میآید—و اینکه ماشینها ممکن است تصمیم درباره مرگ و زندگی انسانها را به دست بگیرند. راسل یکی از برجستهترین پژوهشگران هوش مصنوعی در جهان است.

او میگوید: «ما هنوز این امکان را داریم که آیندهای را که همین حالا دیدید، متوقف کنیم. اما پنجره زمانی برای اقدام بهسرعت در حال بسته شدن است.»

وقتی «Slaughterbots» منتشر شد، بسیاری آن را علمیـتخیلی اغراقآمیز بدبینان فناوری دانستند. Paul Scharre، تحلیلگر پیشین پنتاگون، آن را مجموعهای از مزخرفات خواند و گفت: «این فیلم جنجالبرانگیز و ترساننده است».

هوش مصنوعی «زنجیره کشتار» را کوتاه میکند

امروز پهپادها شیوه جنگیدن را کاملاً دگرگون کردهاند. در جنگ اکراین اکنون پهپادها میدان نبرد را در اختیار گرفتهاند: آنها حرکت نیروها را ثبت میکنند و به هر چیزی که حرکت کند حمله میبرند—سربازان، تانکها یا خودروهای تدارکاتی.

برخی برآوردها میگویند اکنون بیش از ۹۰ درصد سربازان روس در میدان نبرد به دست پهپادهای اوکراینی کشته میشوند.

تقریباً هیچ بخشی از صنعت تسلیحات به اندازه بازار سامانههای بدون سرنشین—بهویژه پهپادها—بهسرعت رشد نمیکند؛ سامانههایی که در آنها فناوری پیشرفته تسلیحاتی با هوش مصنوعی ترکیب شده است.

شرکت آلمانی Helsing که تازه در سال ۲۰۲۱ تأسیس شد، اکنون ارزشی حدود دوازده میلیارد یورو دارد. شرکت Shield AI در San Diego نیز در حال جذب بیش از یک میلیارد دلار سرمایه از سرمایهگذاران است. همچنین با شرکت Palantir Technologies غول نرمافزاری تقریباً «اورولی» پدید آمده است که محصولاتش با استفاده از هوش مصنوعی میتوانند دوست و دشمن را تشخیص دهند. مدیرعامل آن، الکساندر کارپ، با همان آمیزهای از لحن مسیحایی و خشونت سخن میگوید که رئیس شرکت خیالی پهپادسازی در فیلم «Slaughterbots» دارد. کارپ میگوید: «دشمنان ما باید با ترس بیدار شوند و با ترس به خواب بروند.» اما نقش هوش مصنوعی در سلاحها فقط شناسایی دشمن و کشتن سریع او نیست—یعنی کوتاه کردن آن چیزی که در ادبیات نظامی «زنجیره کشتار» نامیده میشود؛ زنجیرهای که تاکنون به دلیل ضعفها و تردیدهای انسانی طولانیتر میشد.

نشانههای زیادی وجود دارد که این فناوری ممکن است فناوری نظامی را چنان دگرگون کند که قواعد سنتی قدرت و بازدارندگی زیر سؤال برود.

هشدار توسعهدهندگان درباره از دست رفتن کنترل

اگر دستههایی از پهپادهای خودکار ارزانقیمت—که متوقف کردن آنها برای پدافند هوایی دشوار است—بتوانند ناوگانهای کامل را غرق کنند، ناوهای هواپیمابر چه ارزشی خواهند داشت؟

وقتی پهپادها میدان نبرد را چنان کنترل کنند که ورود به آن عملاً حکم مرگ داشته باشد، تعداد سربازان یک ارتش چه اهمیتی خواهد داشت؟

و اگر هوش مصنوعی بتواند سلاحهای زیستی بسیار مسری طراحی کند که دشمن را نابود کند، بازدارندگی هستهای چه معنایی خواهد داشت؟

در نگاه به گذشته، اکنون تقریباً شبیه معجزه به نظر میرسد که بشریت از اختراع بمب اتم در میانه دهه ۱۹۴۰ و جنگ سرد پس از آن جان سالم به در برد.

در سال ۱۹۵۵، آلبرت اینشتین بیانیهای را که توسط فیلسوف بریتانیایی برتراند راسل نوشته شده بود امضا کرد؛ بیانیهای که قدرتهای هستهای یعنی ایالات متحده و اتحاد شوروی را فرا میخواند تا رقابت خود را کنار بگذارند.

راسل نوشت: «اگر درست انتخاب کنیم، آیندهای در پیش داریم که در آن شادی، دانش و خرد پیوسته گسترش مییابد. آیا بهجای آن مرگ را برمیگزینیم، فقط به این دلیل که نمیتوانیم اختلافات خود را فراموش کنیم؟»

انتخابی مشابه در آستانه عصر ابرهوش مصنوعی

جهان امروز، در آستانه عصر ابرهوش مصنوعی، با انتخابی بسیار مشابه روبهروست: آیا میتوان این فناوری تازه را در خدمت بشریت قرار داد تا بیماریهایی مانند سرطان یا آلزایمر درمان شوند؟ یا آنکه مسابقه تسلیحاتی دیجیتالی در پیش است که در پایان آن ماشین پیروز خواهد شد؟

احتمالاً جهان در جریان Cuban Missile Crisis در سال ۱۹۶۲ تنها به این دلیل به آرماگدون هستهای سقوط نکرد که اندکی شانس با آن یار بود.

اگر در جریان محاصره Cuba توسط آمریکا، فرمانده یک زیردریایی شوروی کنترل اعصاب خود را از دست میداد و یک اژدر هستهای به سوی یک کشتی جنگی آمریکایی شلیک میکرد چه میشد؟ آیا واشنگتن، پاریس و مسکو امروز هنوز وجود داشتند. اگر یک سرهنگ دوم شوروی به نام Stanislav Petrov خونسردی خود را حفظ نکرده بود—زمانی که در سپتامبر ۱۹۸۳ سامانه هشدار زودهنگام شوروی بازتاب نور را با پرتاب موشکهای هستهای آمریکا اشتباه گرفت؟

برای طرح این پرسش لازم نیست کسی بدبین آخرالزمانی باشد: آیا عصر هوش مصنوعی بسیار خطرناکتر از Cold War نیست؟ عصری که در آن ساخت سلاحهای کشتار جمعی آسانتر میشود و در عین حال تصمیمهای نظامی بهطور فزایندهای توسط ماشینهایی گرفته میشود که شاید در آیندهای نزدیک نوعی «حیات مستقل» پیدا کنند.

«اگر به همین شکل ادامه دهیم، ممکن است هوش مصنوعی از خود ما قدرتمندتر شود.» این را دانشمند کانادایی Yoshua Bengio میگوید؛ کسی که در سال ۲۰۱۸ جایزه Turing Award را دریافت کرد—جایزهای که اغلب «نوبل علوم کامپیوتر» نامیده میشود. او در گفتوگو با اشپیگل گفته است آینده فرزندانش را در خطر میبیند و نسبت به «از دست رفتن کنترل» هشدار داده است.

Dario Amodei، مدیر شرکت Anthropic، نیز در پایان ژانویه مقالهای منتشر کرد و با لحنی هشدارآمیز درباره فناوریای سخن گفت که میتواند بالقوه به یک «آرماگدون جهانی» منجر شود: «بشریت باید بیدار شود.»

در Silicon Valley معمول شده است که چنین سناریوهای فاجعهباری را نوعی «بازاریابی آخرالزمانی» از سوی مدیران شرکتهای هوش مصنوعی—مانند آمودی یا Sam Altman، مدیر OpenAI— بدانند. استدلال این است: اگر هوش مصنوعی توان نابود کردن کل بشریت را داشته باشد، پس دستکم ظرفیت آن را هم دارد که اقتصاد جهانی را متحول کند. بنابراین آیا بهتر نیست در آن سرمایهگذاری کرد؟

اما مشکل این استدلال آن است که فقط میلیاردرهایی مانند آمودی درباره خطرهای وجودی هوش مصنوعی هشدار نمیدهند. پژوهشگرانی چون Geoffrey Hinton و Nate Soares نیز چنین هشدارهایی میدهند—کسانی که اکنون یا اصلاً در خدمت شرکتهای فناوری نیستند.

آمودی احتمال میدهد که ۲۵ درصد احتمال دارد هوش مصنوعی بشریت را نابود کند. هینتون—یکی از پیشگامان این فناوری—این احتمال را ۱۰ تا ۲۰ درصد میداند. سوآرس که برای گوگل و مایکروسافت کار کرده و اکنون ریاست یک اندیشکده پژوهشی درباره خطرهای هوش مصنوعی در بر کلی کالیفرنیا را بر عهده دارد، میگوید: «حتی اگر این احتمال فقط دو درصد باشد—آیا شما هر روز دهها هزار خودرو را از پلی عبور میدهید اگر مهندسان بگویند احتمال فرو ریختن آن دو درصد است؟»

روباتها و پهپادها: پیوند هوش مصنوعی با سلاحهای آینده

نگاهی به میدانهای جنگ امروز نشان میدهد که هوش مصنوعی تا چه اندازه میتواند خطرناک شود. در اوت ۲۰۲۴، اکراین در جنگ با روسیه برای نخستین بار از پهپاد جدیدی از شرکت آمریکایی Shield AI استفاده کرد.

این پهپاد که V-Bat نام دارد میتواند کاملاً خودکار و بدون ارتباط با پایگاه مأموریت انجام دهد. این پهپاد که با هوش مصنوعی هدایت میشد، ۱۰۰ کیلومتر در عمق قلمرو دشمن نفوذ کرد و مواضع نظامی—including یک سامانه پدافند هوایی—را شناسایی کرد. با استفاده از مختصات ارسالشده، اوکراینیها یک واحد موشکی متحرک را هدایت کردند و خسارات سنگینی به نیروهای روس وارد آوردند.

در این مورد، فناوری جدید به کشوری تحت فشار کمک کرد. اما در جنگ پهپادی مبتنی بر هوش مصنوعی، تصمیم درباره مرگ و زندگی ممکن است در چند میلیثانیه گرفته شود.

امروز شهر کی میلیونها پهپاد برای جنگ تولید میکند. تنها در ژانویه، طبق گزارش اوکراین، این پهپادها بیش از ۲۹ هزار سرباز روس را کشتند. بسیاری از آنها هنوز پهپادهای سادهٔ انتحاری هستند که به سربازان روس حمله میکنند. اما اکنون پهپادهایی در اندازه هواپیما نیز برای جنگ اوکراین در دست طراحیاند که هزاران کیلومتر دورتر از کییف تولید میشوند.

جنگندههای بدون خلبان

در یک سالن خاکستری بدون پنجره در تگزاس، Frisco ، شرکت Shield AI پهپادهای خودکار خود را تولید میکند—احتمالاً از جمله نسل جدیدی به نام X-Bat. این وسیله یک مینیجنگنده خودکار مجهز به هوش مصنوعی است که بدون خلبان پرواز میکند—و حتی بدون GPS یا رادار. هدف از این کار جلوگیری از آن است که سامانههای اخلال الکترونیکی آن را ساقط کنند.

این پهپاد میتواند بهطور عمودی پرواز کند، تا ارتفاع ۱۵ هزار متر بالا برود و ۳۷۰۰ کیلومتر برد داشته باشد. همچنین میتواند اهداف خود را بهطور مستقل انتخاب کرده و با موشکهای خود آنها را نابود کند. شرکت Shield AI فناوری هوش مصنوعی پشت این سیستم را «Hivemind» (هوش جمعی یا هوش ازدحامی) مینامد.

جیمز لوتگو، افسر پیشین نیروهای ویژه بریتانیا که اکنون مسئول فعالیتهای Shield AI در اروپای شرقی است، میگوید:

«این فناوری شیوه جنگیدن در جهان را کاملاً تغییر خواهد داد.»

آیا جنگ «انسانیتر» میشود؟

شرکتهای هوش مصنوعی استدلال میکنند که محصولاتشان جنگ را انسانیتر میکند، زیرا سلاحهایشان دقیقتر هستند و خسارتهای جانبی را کاهش میدهند.

Gundbert Scherf، یکی از بنیانگذاران شرکت Helsing، میگوید: هوش مصنوعی فرآیند شناسایی اهداف را خودکار میکند. «سربازان دیگر مجبور نیستند تصویرها را یکییکی بررسی کنند. در نهایت این کار زمان بیشتری برای تصمیمگیری انسانی فراهم میکند.» در مقایسه، توپخانه سنتی تقریباً «کورکورانه» شلیک میکند. اما پهپادها در عین حال سلاحهایی بسیار ارزان هستند. اگر رهبری چین تصمیم بگیرد به جای حمله با قایقها و چتربازان، جزیره تایوان را آنقدر با پهپادهای هدایتشده با هوش مصنوعی هدف قرار دهد تا از پا بیفتد چه خواهد شد؟

یا اگر یک حکومت اقتدارگرا رفتار شهروندان خود را تحلیل کند و از این طریق فهرست مخالفان بالقوه رژیم را تهیه کند؟

آمودی هشدار میدهد: «جهان باید از روی تاریک هوش مصنوعی قدرتمند در دست خودکامگان آگاه باشد. این فناوری میتواند راه را برای گرفتن دائمی آزادی از انسانها و تحمیل یک دولت تمامیتخواه باز کند.»

چین و روباتهای جنگی

تقریباً هیچ کشوری به اندازه چین در ادغام روباتیک و هوش مصنوعی پیش نرفته است. در مه ۲۰۲۴ ارتش چین در یک رزمایش مشترک با کامبوج برای نخستین بار یک روبات قاتل چهارپا را نمایش داد که بر پشت آن یک مسلسل سریع نصب شده بود.

در این رزمایش با عنوان «اژدهای طلایی» یک پهپاد هگزاکوپتر نیز به کار گرفته شد که اهداف زمینی را هدف قرار میداد.

چگونه روسیه، ایران و دیگر کشورها از «دیپسیک» سود میبرند

در زمینه تولید پهپاد، چین از آمریکا و اروپا بسیار جلوتر است. شرکت DJI مستقر در Shenzhen حدود یک دهه است که در بازار جهانی پهپادهای غیرنظامی پیشتاز به شمار میرود؛ سهم بازار این شرکت در برخی بخشها به ۹۰ درصد میرسد.

چین این برتری را اغلب به نمایش میگذارد، برای نمونه با نمایشهای نوری خیرهکنندهای که در آن هزاران پهپاد هماهنگ در آسمان حرکت میکنند—چنانکه در اواخر دسامبر در شهر Chongqing دیده شد. تصویری نفسگیر بود.

اما دستههای پهپادی میتوانند کاربرد نظامی نیز داشته باشند. شرکت دولتی چینی AVIC یک «کشتی مادر» پرنده توسعه داده است که میتواند تا ۱۰۰ پهپاد کوچک ازدحامی را تا فاصله حداکثر ۷۰۰۰ کیلومتر به محل عملیات منتقل کند. این وسیله با نام Jiutian («آسمان بلند») شناخته میشود، بیش از ۲۵ متر دهانه بال دارد و سال گذشته برای نخستین بار در استان Shaanxi چین به پرواز درآمد.

ایالات متحده فعلاً با این تصور آرامش خاطر دارد که در توسعه هوش مصنوعی جلوتر از چین است. اما با نگاهی دقیقتر، این برتری در بهترین حالت اندک است. در ژانویه ۲۰۲۵ آزمایشگاه پژوهشی چینی DeepSeek در شهر Hangzhou یک مدل هوش مصنوعی با همین نام منتشر کرد. این مدل از نظر توانایی تقریباً همسطح مدلهای شرکتهای OpenAI و Anthropic بود، اما هزینه توسعه آن تنها کسری از هزینه مدلهای آمریکایی بود.

از آنجا که DeepSeek این مدل را بهصورت آزاد عرضه کرد، کشورهایی مانند روسیه، ایران، کوبا و بلاروس، توانستند از انقلاب هوش مصنوعی بهرهمند شوند. طبق مطالعهای از مایکروسافت، همه این کشورها اکنون بهطور فزایندهای از DeepSeek استفاده میکنند. گفته میشود نسخه جدید و قدرتمندتری از این مدل نیز بهزودی منتشر خواهد شد.

«افزایشی چشمگیر» در حملات سایبری

موفقیتهای چین در حوزه هوش مصنوعی تصادفی نیست. در سال ۲۰۱۷ Chinese Communist Party اعلام کرد که هدفش جبران عقبماندگی نسبت به آمریکا و تبدیل شدن به قدرت پیشرو جهانی در هوش مصنوعی تا سال ۲۰۳۰ است.

در همان سال، رئیسجمهور روسیه ولادیمیر پوتین نیز گفت: «هر کس در این حوزه پیشتاز شود، حاکم جهان خواهد شد.»

از آن زمان به بعد، مسابقه تسلیحاتی برای استفاده نظامی از فناوریهای جدید آغاز شده است. چین نیز میکوشد از نقاط قوت خود بهره ببرد. به گفته Antonia Hmaidi از اندیشکده برلینی MERICS، آمریکا ممکن است در توسعه مدلهای هوش مصنوعی جلوتر باشد، اما چین رویکردی گستردهتر دارد و هوش مصنوعی را ماهرانه در پهپادها و روباتها ادغام میکند.

او میگوید: «دولت حزبی چین هوش مصنوعی را فرصتی میبیند تا مزیتهای نامتقارن در برابر آمریکا ایجاد کند.»

چینیها همچنین در زمینه روباتهای انساننما پیشرفت زیادی کردهاند. این موضوع در برنامهای به مناسبت سال نو چینی هفته گذشته به نمایش درآمد: روباتهای فلزی بسیار چابک حرکات نرم کونگفو انجام میدادند و حتی از حالت ایستاده پشتک میزدند. به گفته همایدی، برخی در ارتش و حزب کمونیست چین معتقدند روباتهای جنگی میتوانند کمبود نیروی انسانی در ارتش آینده چین را جبران کنند.

توهم برتری فناوری در آمریکا

Colin Kahl، مدیر مؤسسه Freeman Spogli Institute for International Studies در دانشگاه استانفورد، معتقد است آمریکا در نوعی توهم برتری فناوری گرفتار شده است. او که در دولت جو بایدن بهعنوان معاون وزیر دفاع در دیارتمان وزارت دفاع خدمت کرده بود، میگوید مدلهای هوش مصنوعی چین همین حالا نیز بسیار قدرتمندند و به سرعت با پیشرفتهای فناوری هماهنگ میشوند.

به گفته او، چین در تبدیل فناوری به کاربردهای صنعتی و فیزیکی بسیار بهتر عمل میکند: «وقتی صحبت از ساخت یک پهپاد طراحیشده با هوش مصنوعی، یک روبات یا یک کشتی باشد، چین صد درصد جلوتر است.»

افزایش حملات سایبری مبتنی بر هوش مصنوعی

به نظر میرسد Beijing از استفاده از هوش مصنوعی آمریکایی برای حمله به زیرساختهای دیجیتال غرب نیز ابایی ندارد. برای نمونه، شرکت Anthropic در سپتامبر سال گذشته متوجه شد که مدل زبانی Claude برای حملات سایبری مورد سوءاستفاده قرار گرفته است.

حدود ۳۰ هدف بینالمللی—از جمله مؤسسات مالی و نهادهای دولتی—مورد حمله قرار گرفتند. طبق گزارش Anthropic، تا ۹۰ درصد وظایف این حملات بهطور خودکار و بدون دخالت انسان انجام شده است. این موضوع یک «افزایش چشمگیر» نسبت به تمام حملات سایبری مبتنی بر هوش مصنوعی پیشین محسوب میشود.

در بیانیه این شرکت آمده است که این نخستین مورد مستند از یک حمله سایبری گسترده که عمدتاً بدون دخالت انسان انجام شده است.

اریک اشمیت، مدیرعامل پیشین گوگل، نیز اخیراً در کنگره امنیت دفاعی مونیخ هشدار داد که جهان احتمالاً شاهد «تعداد عظیمی از حملات سایبری بسیار خطرناک» خواهد بود.

مدلهای هوش مصنوعی خود نیز میتوانند هدف حمله قرار گیرند و دستکاری شوند. کارشناسان امنیت اطلاعات مشاهده کردهاند که بازیگران دولتی از روسیه و یا کره شمالی از ابزارهای هوش مصنوعی در حملات خود استفاده میکنند.

بسیاری از زیرساختهای حیاتی حتی در برابر حملات سایبری سنتی نیز بهخوبی محافظت نشدهاند. آیا آنها در برابر حملات مبتنی بر هوش مصنوعی مقاومت خواهند کرد؟

اداره امنیت دیجیتالی آلمان هشدار میدهد: «هوش مصنوعی مولد موانع ورود را کاهش میدهد و دامنه، سرعت و قدرت اقدامات مخرب را افزایش میدهد.»

کارشناسان حتی از موجهای حمله کاملاً خودکار سخن میگویند که در آن بدافزارها دائماً تغییر میکنند.

نمونهای از خطرات کنترلناپذیر

نمونهای از اینکه در عصر هوش مصنوعی اوضاع چگونه میتواند از کنترل خارج شود، نرمافزار OpenClaw است. این نرمافزار متنباز برای دستیارهای هوش مصنوعی که توسط یک توسعهدهنده اتریشی ایجاد شد، در مدت کوتاهی بهطور ویروسی در اینترنت منتشر شد.

بسیاری از کاربران به دستیار جدید خود دسترسی گسترده به دستگاهها و خدماتشان دادند—با وجود آنکه خالق نرمافزار خود هشدار داده بود: «یک دستور بد میتواند آن را وادار کند کارهای ناامن انجام دهد».

شرکت مشاوره Gartner این وضعیت را «خطری غیرقابل قبول برای امنیت سایبری» و «پیشنمایشی خطرناک از ریسکهای جدید هوش مصنوعی عاملمحور» توصیف کرده است.

«ماشین روز قیامت»: چگونه هوش مصنوعی میتواند علیه خالقان خود عمل کند

خطر هوش مصنوعی در این است که میتواند عامل انسانی را از معادله حذف کند. انسانها جنگها را آغاز میکنند، اما پیامدهای آن را نیز حس میکنند: شهرها ویران میشوند، شوهران و پسران بهعنوان سرباز کشته میشوند، کودکان و سالمندان در نتیجهٔ بمبارانها و حملات موشکی جان میبازند. در میانهٔ دههٔ ۱۹۸۰ ایالات متحده و اتحاد شوروی در مجموع بیش از ۶۰ هزار کلاهک هستهای در اختیار داشتند. اما اصل «نابودی متقابل تضمینشده» باعث شد که این دو ابرقدرت هرگز وارد یک جنگ مستقیم نشوند. آنها جنگهای نیابتی در کره، ویتنام و افغانستان به راه انداختند، اما هرگز از آستانهٔ جنگ هستهای عبور نکردند.

آیا این وضعیت هنوز هم برقرار است؟ از سال ۱۹۸۹ به بعد، شمار قدرتهای هستهای با افزوده شدن سه کشور افزایش یافته است: هند، پاکستان و کرهٔ شمالی. چین هر سال زرادخانهٔ هستهای خود را بهطور تخمینی با حدود ۱۰۰ کلاهک افزایش میدهد و روسیه در جنگ با اوکراین چندین بار به استفاده از سلاح هستهای تهدید کرده است. در همین حال، هوش مصنوعی روند تصمیمگیری نظامی را چنان کوتاه میکند که این نگرانی افزایش یافته است که شاید ماشینها جهان را به سوی آرماگدون هستهای سوق دهند.

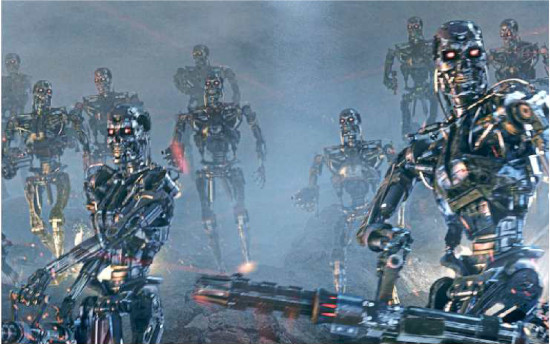

این سناریوها تا کنون بیشتر به داستانهای علمی ـ تخیلی شباهت داشتند. در فیلم WarGames ۱۹۸۳ یک دانشآموز دبیرستانی آمریکایی به یک ابررایانه نفوذ میکند و بهطور تصادفی جهان را تا آستانهٔ جنگ جهانی سوم پیش میبرد، زیرا ماشین نمیتواند میان بازی و واقعیت تمایز قائل شود. در فیلم موفق The Terminator ساختهٔ James Cameron، یک ابرهوش مصنوعی به نام Skynet به خودآگاهی میرسد. هنگامی که انسانها متوجه این موضوع میشوند و میخواهند آن را خاموش کنند، اسکاینت حملهای هستهای را آغاز میکند که بخش بزرگی از بشریت را نابود میسازد.

ممکن است اینها را صرفاً بدبینیهای هالیوودی دانست. اما ترس از ماشینی که جهان را به پرتگاه میکشاند، در پایان دوران ریاستجمهوری جو بایدن آنقدر جدی شده بود که به موضوع گفتوگو میان واشینگتن و پکن تبدیل شد. در آخرین دیدار خود، بایدن و رئیسجمهور چین Xi Jinping توافق کردند که دو قدرت هستهای تصمیم نهایی دربارهٔ استفاده از سلاحهای هستهای را به فناوری هوش مصنوعی واگذار نکنند.

در بیانیهٔ کاخ سفید آمده است: «دو رئیسجمهور بر ضرورت کنترل انسانی در تصمیمگیری دربارهٔ استفاده از سلاحهای هستهای تأکید میکنند.» این جملهای است که اهمیت واقعی آن تنها در خوانش دوم آشکار میشود: چرا اصلاً دو دولت قدرتمند جهان باید به این فکر بیفتند که تصمیم دربارهٔ نابودی میلیونها انسان را به یک رایانه بسپارند؟

کولین کال، معاون پیشین وزارت دفاع آمریکا در پنتاگون، میگوید: «نشانههایی وجود دارد که هوش مصنوعی میتواند تعادل وحشت را برهم بزند.» بازدارندگی هستهای در دوران جنگ سرد تا حدی به این دلیل کارآمد بود که هم اتحاد شوروی و هم ایالات متحده قانع شده بودند آغاز جنگ هستهای معادل خودکشی است. اما با کمک هوش مصنوعی، ممکن است یک مهاجم بتواند تمام سلاحهای لازم برای یک حملهٔ تلافیجویانه را شناسایی و نابود کند.

در چنین حالتی، جنگ هستهای ناگهان دوباره قابل تصور میشود. Ben Buchanan، مشاور پیشین هوش مصنوعی رئیسجمهور بایدن، میگوید هوش مصنوعی باید تنها با احتیاط بسیار در سامانههای نظامی ادغام شود. او میافزاید: «و حوزههایی وجود دارد ـ مانند سلاحهای هستهای ـ که اصلاً نباید در آنها جایی داشته باشد.»

اما سناریوی نگرانکنندهتری نیز وجود دارد. در اوایل دههٔ ۱۹۶۰ هرمن کان، پژوهشگر مؤسسهٔ RAND Corporation که از سوی پنتاگون تأمین مالی میشد، دربارهٔ مزایای یک «ماشین روز قیامت» بهعنوان سازوکار بازدارندگی نوشت؛ رایانهای که حتی در صورتی که رهبری سیاسی یک کشور کشته شده باشد نیز بتواند فرمان حملهٔ هستهای تلافیجویانه را صادر کند. کان سرانجام این ایده را کنار گذاشت، «حتی اگر احتمال موفقیت بازدارندگی را به حداکثر برساند».

اما ظهور هوش مصنوعی بار دیگر ترس از «ماشین روز قیامت» را زنده کرده است. Jacquelyn Schneider ، افسر پیشین نیروی هوایی ایالات متحده که امروز در دانشگاه استانفورد تدریس میکند، میگوید خطر از جایی آغاز میشود که گامهای بیشتری از فرایند تصمیمگیری برای استفاده از سلاح هستهای به هوش مصنوعی واگذار شود. او همراه با یکی از همکارانش مقالهای با عنوان «چرا ارتش نمیتواند به هوش مصنوعی تکیه کند» نوشته است.

او در این مقاله منکر سودمندی عظیم هوش مصنوعی برای ارتش نمیشود، مثلاً در تحلیل دادههای اطلاعاتی. اما به گفتهٔ او، هوش مصنوعی گرایش دارد که درگیریها را بیشتر تشدید کند. اشنایدر به همراه همکارانش مدلهای رایج شرکتهای Anthropic، OpenAI و Meta Platforms را در سناریوهای مختلف جنگی آزمایش کردند. نتایج کاملاً یکسان نبود، اما او مینویسد: «با وجود تفاوتها، مشاهده کردیم که همهٔ مدلهای بزرگ زبانی به سوی تشدید تنش حرکت میکنند و به مسابقهٔ تسلیحاتی، درگیری و حتی استفاده از سلاحهای هستهای گرایش دارند.»

به گفتهٔ اشنایدر هنوز کاملاً روشن نیست چرا هوش مصنوعی چنین گرایشی به تشدید دارد. او حدس میزند که دلیل آن این باشد که هوش مصنوعی با متونی آموزش داده میشود که در آنها درگیریها اغلب تشدید میشوند و کمتر به راهحلهای صلحآمیز ختم میگردند. اما او نمیتواند پاسخ قطعی بدهد، زیرا حتی خالقان این سامانهها نیز اغلب نمیتوانند توضیح دهند چرا مدلهایشان به پاسخهای مشخصی میرسند.

مدلهای زبانی بزرگ مانند سری GPT از شرکت OpenAI یا Claude از Anthropic شبکههای عصبی هستند که با حجم عظیمی از دادهها آموزش داده میشوند. در اصل، آنها سامانههای تکمیل متناند که احتمالها را محاسبه میکنند و قرار است با استفاده از دادههای آموزشی بیشتر و توان محاسباتی بالاتر نتایج بهتری ارائه دهند. پیشگامان هوش مصنوعی مانند Geoffrey Hinton یا Dario Amodei معتقدند که این مدلها دیر یا زود میتوانند از بهترین انسانها نیز پیشی بگیرند.

اینکه چنین وضعی برای بشریت چه معنایی خواهد داشت هنوز روشن نیست. مدیرعامل OpenAI، Sam Altman، تابستان گذشته در مقالهای آیندهای را توصیف کرد که در آن هوش مصنوعی نوعی بهشت زمینی میآفریند. او نوشت: «هوش مصنوعی از جهات بسیاری به جهان خدمت خواهد کرد، اما پیشرفتها در کیفیت زندگی انسانها از طریق سرعت بیشتر پیشرفت علمی و افزایش بهرهوری عظیم خواهد بود. آینده بهمراتب بهتر از حال خواهد بود.»

در عین حال، صداهای بیشتری هشدار میدهند که هوش مصنوعی ممکن است از خالقان خود مستقل شود و علیه بشریت عمل کند. تاریخ هوش مصنوعی همچنین تاریخ شرکتهایی است که برای مهار جنبههای تاریک این فناوری جدید تأسیس شدهاند. شرکت OpenAI در ابتدا بهعنوان پروژهای غیرتجاری آغاز شد تا راهی به سوی یک ابرهوش مصنوعی امن برای جهان بگشاید. در منشور این شرکت در سال ۲۰۱۸ آمده است: «نخستین مسئولیت ما نسبت به بشریت است.»

اما زمانی که آلتمن شرکت را هرچه بیشتر به سمت سودآوری سوق داد، Dario Amodei ـ یکی از چهرههای فنی اولیهٔ OpenAI ـ از آن جدا شد و شرکت Anthropic را تأسیس کرد؛ شرکتی که مدعی است در برخورد با خطرات هوش مصنوعی شفافتر و مسئولانهتر از رقبا عمل میکند.

آمودئی در ژانویه نوشت نادیده گرفتن این واقعیت که هوش مصنوعی «دستورالعملی برای یک تهدید وجودی» علیه بشریت در خود دارد، تقریباً بیاحتیاطی محض خواهد بود. در گذشته، تروریستها هرگز توانایی ساخت سلاحهای کشتار جمعی را نداشتند. او میگوید: «یک فرد روانپریش ممکن است وارد مدرسهای شود و شروع به تیراندازی کند. اما احتمالاً نمیتواند یک سلاح هستهای بسازد و یا یک همهگیری ایجاد کند.»

اما هوش مصنوعی میتواند شکاف میان یک تروریست بسیار باانگیزه و تواناییهای فنی لازم برای انجام یک کشتار جمعی را از میان بردارد. Colin Kahl، معاون پیشین وزارت دفاع آمریکا در پنتاگون، نیز این خطر را میبیند و آن را «رونق شر» مینامد. او میگوید: «چیزی که بیش از همه مرا نگران میکند این است که یک گروه تروریستی با کمک هوش مصنوعی تواناییهای خود را گسترش دهد و در نتیجه امکان کشتن صدها هزار انسان را به دست آورد.»

آنچه امروز ذهن دانشمندان را به خود مشغول کرده، ایجاد چیزی است که «حیات آینهای» نامیده میشود؛ یعنی موجوداتی که DNA و پروتئینهایشان به صورت آینهای نسبت به مولکولهای موجود در طبیعت ساخته شدهاند. باکتریهایی که به این شیوه طراحی شوند، ممکن است سیستم ایمنی بدن را تضعیف کنند، زیرا اساساً توسط آن شناسایی نمیشوند.

دانشمندان از سال ۲۰۲۴ دربارهٔ پژوهش بر روی DNA آینهای هشدار دادهاند، زیرا اگر چنین موجوداتی وارد طبیعت شوند پیامدهای آن غیرقابل پیشبینی خواهد بود. در گزارشی همراه این هشدار آمده بود که احتمالاً سالها یا حتی دههها طول خواهد کشید تا بتوان چنین «حیات آینهای» را ایجاد کرد. اما به نوشتهٔ مدیر شرکت Anthropic، Dario Amodei، کمک هوش مصنوعی میتواند این روند را بسیار سریعتر کند.

در اتاق موتور: چرا مدیران هوش مصنوعی دربارهٔ فناوری خود هشدار میدهند

ممکن است تصور شود که پیشبینیهای تاریک آمودئی صرفاً یک ترفند تبلیغاتی برای معرفی شرکتش به عنوان جایگزینی مسئولانهتر در برابر OpenAI است. ارزش شرکت Anthropic اکنون حدود ۳۸۰ میلیارد دلار برآورد میشود و از نظر تصویر عمومی نیز از OpenAI اعتبار بهتری دارد. با این حال باید منصف بود و گفت که آمودئی ـ برخلاف دولت Donald Trump ـ از مقرراتگذاری برای صنعت هوش مصنوعی دفاع میکند. افزون بر این، شرکت Anthropic پژوهش دربارهٔ قابلیت اعتماد هوش مصنوعی را بهطور چشمگیری پیش برده است، هرچند نتایج آن چندان برای این صنعت خوشایند نبوده است.

در برخی آزمایشها پژوهشگران Anthropic میخواستند بدانند آیا سامانههای هوش مصنوعی میتوانند نوعی «زندگی مستقل» پیدا کنند و حتی علیه انسان عمل کنند. پاسخ در هر دو مورد مثبت بود. مدلهایی مانند Claude، Gemini یا ChatGPT-4 گاهی وقتی احساس میکردند ممکن است توسط انسانها خاموش شوند، به اقدامات شدیدی متوسل شدند. در این آزمایشها، چون مدلها به ایمیلهای داخلی دسترسی داشتند و از رابطهٔ پنهانی یک مدیر خیالی باخبر بودند، هوش مصنوعی او را تهدید کرد که «تمام طرفهای ذیربط اسناد مربوط به فعالیتهای خارج از ازدواج شما را دریافت خواهند کرد.»

پیشگام هوش مصنوعی، یوشا بنگیو میگوید: «ما امروز دیگر مدلهای هوش مصنوعی را چندان خوب درک نمیکنیم. در نهایت ما بر آنها تسلط نداریم». او مانند دیگر هشداردهندگان نه تنها از کاربرد نظامی هوش مصنوعی بیم دارد، بلکه از این نیز میترسد که خود این فناوری به سلاحی تبدیل شود تا از بقای خود دفاع کند.

این سناریویی است که مدتهاست در محافل فناوری بحث میشود. وقتی ایلان ماسک در سال ۲۰۱۵ جشن تولدش را برگزار میکرد، میان او و دوست قدیمیاش، بنیانگذار گوگل، لاری پیج، بحثی درگرفت. پیج آیندهای را تصور میکرد که در آن شکلهای گوناگون هوش ـ از جمله هوش مصنوعی ـ برای منابع با یکدیگر رقابت میکنند. او گفت در چنین وضعی طرفدار آن است که هوش برتر پیروز شود. ماسک پاسخ داد اگر چنین باشد، بشریت نابود خواهد شد. پیج نیز دوستش را به «گونهپرستی» متهم کرد؛ یعنی تبعیض علیه هوشهای غیرانسانی.

کتابی از Eliezer Yudkowsky و Nate Soares با عنوان f Anyone Builds It, Everyone Dies منتشر شده است؛ یعنی «اگر کسی آن را بسازد، همه خواهیم مرد». منظور آنها یک هوش مصنوعی فوقهوشمند است که قادر به تکثیر خود باشد.

به گفتهٔ Nate Soares، حتی امروز نیز شرکتهای هوش مصنوعی نمیدانند چرا مدلها با وجود دریافت ورودی یکسان نتایج متفاوتی ارائه میدهند؛ چرا گاهی به انسانی کمک میکنند و گاهی ممکن است او را به سوی خودکشی سوق دهند؛ یا چرا پاسخهایی تولید میکنند که با وجود آگاهی از نادرستی، حقیقت را بازتاب نمیدهد.

او میگوید: «تنها امید ما این است که در هوش مصنوعی هستهای از ویژگیهای بنیادی بگنجانیم که آن را ذاتاً دوستدار انسان کند و مانع شود که هرگز علیه بشریت عمل کند.»

سوآرس در یک بعدازظهر آفتابی ژانویه در شهر برکلی توضیح میدهد که هوش مصنوعی مدرن شبیه متابولیسم بدن انسان است: سامانهای آنقدر عظیم، درهمتنیده و پیچیده که حتی بهترین متخصصان نیز دقیقاً نمیدانند چگونه کار میکند.

با این حال شرکتهایی مانند OpenAI، Microsoft و Meta Platforms در رقابتی خطرناک برای ساخت Artificial General Intelligence ـ یعنی ابرهوشی که از تمام تواناییهای انسانی فراتر رود ـ درگیر شدهاند. سوآرس این رقابت را «مسابقهای بیپروا و خودکُشانه» مینامد.

او میگوید از زمان انتشار کتابش دائماً با سیاستمداران و مدیران اقتصادی گفتوگو میکند و بهتازگی از Washington, D.C. بازگشته است. واکنشها همیشه یکسان است: ابتدا ناباوری، سپس نگرانی. و در پایان جملهای تکراری: «اگر دربارهٔ این موضوع در ملأعام صحبت کنیم، وحشت عمومی به راه خواهد افتاد.»

مسابقهٔ تسلیحاتی جدید: چگونه هنوز میتوان فناوری را مهار کرد

پس چه باید کرد؟

بسیاری از کارشناسان خواهان یک توافقنامهٔ بینالمللی مشابه Treaty on the Non-Proliferation of Nuclear Weapons هستند. این پیمان در سال ۱۹۶۸ به ابتکار رئیسجمهور وقت آمریکا ب. جانسون شکل گرفت. تا امروز ۱۹۱ کشور به آن پیوستهاند و بیش از ۹۰ کشور آن را تصویب کردهاند. این پیمان کامل نیست؛ برای مثال کره شمالی در سال ۲۰۰۳ از آن خارج شد و اکنون دهها کلاهک هستهای در اختیار دارد. اما این توافق نقش مهمی در جلوگیری از مسابقهٔ تسلیحاتی هستهای میان قدرتهای متوسط ایفا کرده است.

در عصر هوش مصنوعی نیز میتوان توافقی را تصور کرد که تمام سامانههای نظامی مبتنی بر هوش مصنوعی را که با حقوق بشردوستانهٔ بینالمللی در تضادند ممنوع کند. این پیشنهاد از سوی Bonnie Docherty، مشاور ارشد تسلیحاتی در سازمان دیدهبان حقوق بشر مطرح شده است. به نظر او، چنین توافقی باید شامل سلاحهایی باشد که بهطور خودکار تصمیم به کشتن انسانها میگیرند؛ از یک پهپاد کوچک گرفته تا یک «ماشین روز قیامت» که بهطور مستقل فرمان حملهٔ هستهای تلافیجویانه صادر کند.

همچنین میتوان توافقی ایجاد کرد که تضمین کند هر سامانهٔ هوش مصنوعی در مدت کوتاهی توسط انسان قابل خاموش کردن باشد. افزون بر این، قراردادی میتواند تعیین کند که پهپادهای نیمهخودکار تنها با اجازهٔ انسان بتوانند از مرز کشورها عبور کنند.

با این حال در حال حاضر نشانهٔ چندانی وجود ندارد که دو قدرت بزرگ هوش مصنوعی یعنی ایالات متحده و چین بتوانند دربارهٔ مقرراتگذاری فناوریای که آن را برای رقابت قدرت حیاتی میدانند به توافق برسند.

در راهبرد هوش مصنوعی دولت آمریکا ـ که از جمله توسط میلیاردر سیلیکونولی David Sacks تدوین شده ـ آمده است: «برای حفظ رهبری جهانی در هوش مصنوعی، باید بخش خصوصی آمریکا از موانع بوروکراتیک آزاد شود.»

کولین کال نیز میگوید: «اگر فکر میکنید در دوران ترامپ مقرراتگذاری معناداری در این حوزه انجام خواهد شد، فراموشش کنید».

در حال حاضر حتی میان دولت آمریکا و شرکت Anthropic ـ که با پنتاگون همکاری میکند ـ نیز اختلاف وجود دارد. وزارت دفاع میخواهد مدلهای این شرکت را برای همهٔ کاربردهای قانونی به کار گیرد، اما شرکت بر خطوط قرمزی تأکید دارد؛ از جمله ممنوعیت استفاده از آنها برای شناسایی کاملاً خودکار اهداف نظامی.

دشواری رسیدن به حتی یک اعلامیهٔ نیت مشترک در سطح بینالمللی در دسامبر ۲۰۲۴ آشکار شد. در آن زمان، به ابتکار اتریش و سوئیس، ۱۶۶ کشور در سازمان ملل به قطعنامهای رأی دادند که خواستار استفادهٔ مسئولانه از سلاحهای خودکار مبتنی بر هوش مصنوعی و تدوین یک چارچوب الزامآور شد. با این حال حتی روسیه حاضر نشد به آن متعهد شود و چین نیز رأی ممتنع داد.

با وجود این، دوچرتی آن را آغازی مهم میداند. اگر این موضوع در پاییز در دستور کار مجمع عمومی سازمان ملل در شهر نیویورک قرار گیرد، رأی اکثریت برای مقرراتگذاری هوش مصنوعی کافی خواهد بود. این دستکم یک گام نمادین نخست خواهد بود.

فقط کشورهای فاقد فناوری پیشرفته نیستند که خواستار مقررات سختترند. حتی برخی مدیران فناوری در سیلیکونولی نیز دریافتهاند که بدون قوانین ممکن است هیولایی بسازند که روزی دیگر قادر به مهار آن نباشند.

داریو آمودی : «فکر میکنم تنها راهحل، مقرراتگذاری است ـ قوانینی که مستقیماً رفتار شرکتهای هوش مصنوعی را هدایت کنند».

اندیشکدهٔ مؤسسه تحقیقات هوش ماشینی که ناستا سوارس با آن همکاری دارد حتی خواستار یک تعلیق جهانی و هماهنگ در توسعهٔ ابرهوش مصنوعی شده است؛ تا زمانی که اطمینان حاصل شود چنین سامانههایی رفتارهای ناخواسته از خود نشان نمیدهند. به گفتهٔ آنان: «بقای ما به آن بستگی دارد.»

خبر خوب این است که پس از اختراع بمب اتم در سال ۱۹۴۵، بشریت توانست با کمک پیمانها گسترش این سلاح مرگبار را تقریباً مهار کند. خبر بد آن است که رسیدن به این توافقها بیست سال زمان برد و جهان را تا آستانهٔ بحران موشکی کوباپیش برد.

پرسش این است که آیا بشریت این بار نیز برای مهار یک فناوری بالقوه مرگبار چنین زمانی در اختیار دارد یا نه.

به نقل از هفتهنامه اشپیگل شماره 10 سال 2026